Get data of dictionaries

Imaginemos que tenemos el siguiente diccionario

InputPythondictionary = {"id": 1,"name": "John","age": 30}Copied

Si queremos obtener el valor de la edad lo que se suele hacer es dictionary["age"]

InputPythondictionary = {"id": 1,"name": "John","age": 30}dictionary["age"]Copied

30

Pero, ¿qué pasa si la key que ponemos no está en el diccionario? ¿Nos dará un error?

InputPythondictionary["country"]Copied

---------------------------------------------------------------------------KeyError Traceback (most recent call last)Cell In[4], line 1----> 1 dictionary["country"]KeyError: 'country'

Por lo que si esto pasa en producción se caerá el programa

Así que para solucionarlo podemos usar un try except para manejar el error

InputPythontry:dictionary["country"]except KeyError:print("Key not found")Copied

Key not found

Pero otra solución para no llenar el código de try except es usar el método get que nos permite obtener el valor de una key y si no existe nos devuelve un valor por defecto

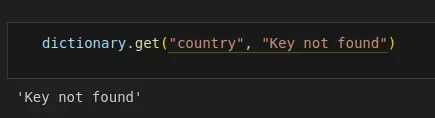

InputPythondictionary.get("country", "Key not found")Copied

'Key not found'

Otra opción es no colocar la segunda opción, en ese caso obtenemos None si la key no existe

InputPythoncountry = dictionary.get("country")print(country)Copied

None